LLM

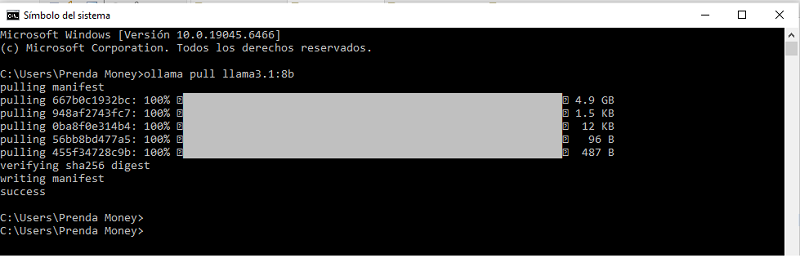

Primero hay que instalar ollama para utilizar nuestro modelo de manera local.Una vez intalado ollama abrimos el cmd ejecutamos el siguiente comando ollama pull llama3.1:8b

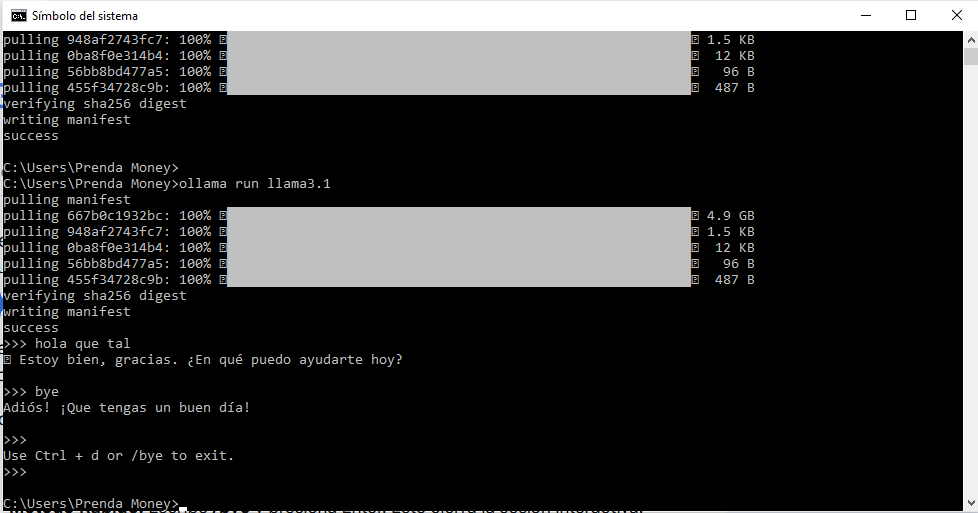

Una vez instalado llama ejecutamos el siguiente comando ollama run llama3.1

Saludamos para probar y salimos en Ctrl+d